Crime

Mulher é assassinada a facadas em Jequié; companheiro é preso suspeito

Patrícia dos Santos, de 49 anos, foi morta a facadas em Jequié, Bahia. O companheiro, de 46 anos, foi preso e internado sob custódia. Polícia investiga o caso.

Cultura

Katy Perry usa máscara metalizada e roupa toda branca no Met Gala 2026

Katy Perry compareceu ao Met Gala 2026 com um vestido branco de Stella McCartney e máscara metalizada que cobria todo o rosto, seguindo sua tradição de looks inusitados.

Política

EUA e Irã trocam acusações sobre controle do Estreito de Ormuz

EUA anunciam operação para liberar navios no Estreito de Ormuz, mas Irã nega e afirma controlar a passagem. Guerra de versões entre os países gera incertezas e impacto no preço do petróleo.

Economia

Portugal endurece regras para cidadania de imigrantes, inclusive brasileiros

Nova lei portuguesa amplia prazo para pedido de cidadania: 7 anos para UE e 10 para outros. Crianças nascidas em Portugal também são afetadas.

Acidentes

Saúde

Morre Doris Fisher, cofundadora da Gap

Doris Fisher, cofundadora da icônica rede de roupas Gap Inc., faleceu aos 94 anos. Ela e o marido Don Fisher abriram a primeira loja em 1969, criando um império global do varejo com marcas como Banana Republic e Old Navy.

Porto Alegre sem vacina Covid para maiores de 12 anos

Porto Alegre está sem doses contra Covid-19 para pessoas a partir de 12 anos. Desabastecimento depende do Ministério da Saúde. Crianças continuam vacinadas.

Eventos Históricos Mais Polêmicos do Mundo

Descubra os acontecimentos históricos mais controversos que geraram debates e mudanças profundas na sociedade. Uma análise dos fatos que desafiaram o certo e errado.

TCE dá prazo para plano de saúde mental infantojuvenil em SE

Tribunal de Contas de Sergipe estabelece prazo de 90 dias para governo estadual apresentar plano de ampliação da rede de saúde mental de alta complexidade para crianças e adolescentes.

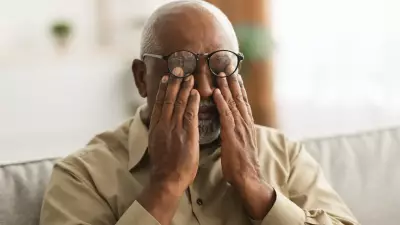

Campanha 24 Horas pelo Glaucoma alerta para diagnóstico precoce

CBO e SBG lançam campanha 24 Horas pelo Glaucoma em maio. Doença silenciosa é a maior causa de cegueira irreversível. Diagnóstico precoce é essencial.

Trânsito

Receba Atualizações

Inscreva-se na nossa newsletter para receber as últimas atualizações na sua caixa de entrada!

Odiamos spammers e nunca enviamos spam

Educação

Desafio Esportivo de Segunda-feira: Questões sobre Futebol, Vôlei e Fórmula 1

Comece sua semana com nosso quiz esportivo de segunda-feira com 100 questões sobre futebol, vôlei e Fórmula 1 brasileiros. O quanto você conhece esses esportes populares no Brasil?