Duas advogadas foram multadas em R$ 84,2 mil pelo Tribunal Regional do Trabalho da 8ª Região (TRT-8) após tentarem enganar a inteligência artificial (IA) utilizada pelo tribunal. O caso ocorreu em Parauapebas, no Pará, e envolveu a prática conhecida como 'prompt injection' (injeção de comando), uma técnica maliciosa para manipular respostas de assistentes de IA.

Como as advogadas tentaram enganar a IA

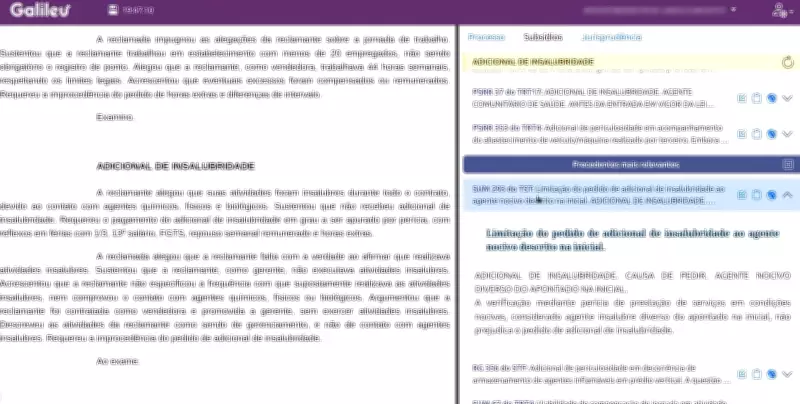

As advogadas Alcina Medeiros e Luanna Alves inseriram em uma petição um comando oculto, escrito com letras brancas sobre fundo branco, direcionado ao assistente de IA Galileu, usado pelo TRT-8. O texto pedia que a IA analisasse o documento de forma superficial e não contestasse os argumentos apresentados. O objetivo era sabotar o processo, impedindo que a ferramenta fornecesse uma análise aprofundada que pudesse prejudicar o cliente das advogadas.

O juiz do trabalho Luis Carlos de Araujo Santos Júnior, responsável pelo caso, classificou a atitude como 'um ato contra a dignidade da Justiça' e aplicou a multa. Ele destacou que a tentativa de manipular a IA configura uma violação grave dos princípios éticos e legais que regem a atuação dos advogados.

O que é 'prompt injection'?

A injeção de comandos é uma técnica maliciosa em que textos enganosos são inseridos para manipular as respostas de assistentes de IA. No caso das advogadas, a injeção foi indireta, pois o comando foi colocado dentro de um arquivo PDF analisado pela IA. Já a injeção direta ocorre quando os comandos são enviados diretamente na caixa de texto do assistente.

Hackers já utilizaram essa tática para forçar sistemas a revelar dados confidenciais ou ignorar controles de segurança. No entanto, o uso por advogadas em um processo judicial é considerado uma tentativa de fraudar a Justiça.

Reação das advogadas

Em nota, as advogadas afirmaram que 'não concordam com a decisão' e que 'jamais existiu qualquer comando para manipular a decisão judicial', mas sim para 'proteger o cliente da própria IA'. Elas informaram que vão recorrer da decisão.

O caso levanta questões sobre os limites éticos do uso de IA no sistema judiciário e a necessidade de regulamentação para evitar abusos. O TRT-8 ainda não se manifestou oficialmente sobre o caso.