Pesquisa da Unicamp expõe operação organizada de grupos antivacina no Telegram

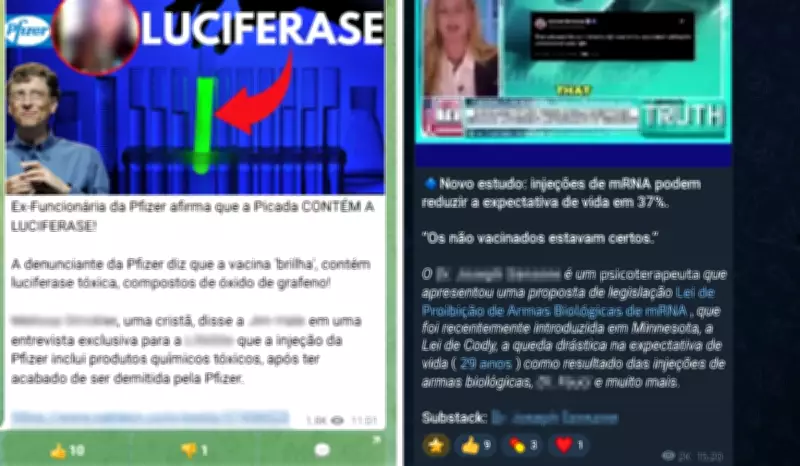

Um estudo abrangente realizado pela Universidade Estadual de Campinas (Unicamp) entre 2020 e 2025 analisou mais de quatro milhões de mensagens publicadas no aplicativo Telegram, revelando como conteúdos antivacina circulam no Brasil e representam um risco concreto à saúde pública nacional. A pesquisa, conduzida pelo Laboratório de Inteligência Artificial Recod.ai, identificou redes organizadas, uso de robôs e estratégias coordenadas que influenciam diretamente a recusa à vacinação em território brasileiro.

Plataforma se torna refúgio para desinformação

O banco de dados construído pelos pesquisadores reúne impressionantes 5,5 terabytes de informações, com conteúdos compartilhados por mais de 71 mil usuários distribuídos em 119 grupos diferentes. Segundo os especialistas, o Telegram se transformou em um terreno fértil para a desinformação devido às suas condições operacionais específicas, que incluem menor moderação de conteúdo e maior anonimato para os usuários.

"Além de ser mais fácil tecnicamente a extração, o Telegram também se tornou um refúgio da desinformação, por conta dessa moderação que é mais maleável ali dentro", afirma Christiane Versuti, pós-doutoranda em Ciências Sociais e Comunicação que integra a equipe de pesquisa.

A estrutura de disseminação identificada pelos pesquisadores é altamente organizada e apresenta diferentes tipos de canais com funções bem definidas. "Existem canais que somente mandam desinformação, existem canais que recebem e que mandam e existem canais que só recebem. Pelo volume, ficou claro, por exemplo, que existem robôs por trás disso", explica Michelle Diniz Lopes, doutoranda em matemática com especialização em estatística e neurociências.

Do tráfico de documentos falsos a protocolos perigosos

A pesquisa demonstra que esses grupos antivacina vão muito além da simples disseminação de desinformação, funcionando como espaços para práticas ilegais e potencialmente perigosas para a população. "A gente vê crimes acontecendo ali de fraude, de venda de carteirinha", revela Versuti sobre as atividades identificadas.

Entre as práticas documentadas estão:

- Oferta de comprovantes falsos de vacinação usados para burlar exigências sanitárias

- Anúncios de "protocolos alternativos" sem qualquer base científica

- Venda de cursos, suplementos e até hormônios como testosterona

- Promoção de métodos de "desintoxicação" pós-vacina

"Para além de somente divulgar narrativas, eles também induzem as pessoas a talvez colocarem a sua saúde em risco", alerta Ana Carolina Monari, pós-doutoranda em jornalismo e doutora em informação e comunicação em saúde.

Comunicação científica precisa ser mais acessível

Para a equipe de pesquisadores, combater efetivamente a desinformação não depende apenas da remoção de conteúdos ou da punição dos responsáveis. A forma como a informação científica chega ao público também precisa passar por transformações significativas.

"Acho que uma forma de tentarmos alcançar essas pessoas é por meio da comunicação. De uma comunicação talvez mais compreensiva, mais empática", defende Monari, destacando que muitos usuários desses grupos não se veem como desinformados, mas como excluídos do debate público.

A pesquisadora relata que "muitos deles dizem 'eu estou cansado de pessoas me dizerem que sou ignorante, que sou negacionista. E aqui eu me sinto acolhido para poder falar o que eu penso e as pessoas não vão me taxar por ignorante'", revelando a dimensão psicológica e social do problema.

Próximos passos da pesquisa

Atualmente, a equipe trabalha na coleta e integração de dados de outras plataformas digitais, incluindo Instagram, YouTube e X (antigo Twitter), para compreender como a desinformação circula entre diferentes redes sociais e ganha escala exponencial.

Os pesquisadores também desenvolvem modelos avançados de inteligência artificial capazes de classificar automaticamente os conteúdos, com foco especial em:

- Identificar diferentes tipos de desinformação

- Compreender os mecanismos de disseminação de cada variante

- Detectar conteúdos gerados por inteligência artificial

- Analisar imagens e vídeos sintéticos usados para reforçar narrativas antivacina

"Tem um outro tipo de problema, que é quando a gente tem uma mensagem que ela não era realmente desinformativa, às vezes ela só era uma ironia, uma piada, uma charge, e às vezes em uma análise automática ela pode ser interpretada como desinformação e causar um equívoco em todo o processo de análise", comenta Leopoldo Lusquino Filho, colaborador do Recod.ai e professor da Unesp.

No médio prazo, os pesquisadores pretendem aprofundar o entendimento sobre diferentes públicos vulneráveis, analisando como idosos e comunidades indígenas, por exemplo, consomem informação sobre saúde. "Os nossos dados que a gente está baixando, que a gente já baixou, que a gente vai baixar, eles vão ficar públicos para que a gente possa promover sempre o compartilhamento livre e transparente do conhecimento científico", complementa Michelle Diniz Lopes.

O banco de dados totalmente aberto, disponível para uso sem finalidades comerciais, já está acessível no Repositório de Dados da Unicamp, representando um importante recurso para pesquisadores, autoridades de saúde e sociedade civil no combate à desinformação sobre vacinas.